Du Taylorisme… à l’IA

Développé par l’ingénieur américain Frederick Winslow Taylor à partir de 1880, le taylorisme est une doctrine d’organisation du travail qui se veut scientifique. Elle repose sur une division horizontale du travail, avec un principe simple : fragmenter le travail en tâches simples et répétitives, faciles à apprendre et à contrôler.

Lorsque Charles Taylor invente sa méthode, utilisée dans l’automobile puis par la suite dans la restauration rapide et bien d’autres industries, il n’a sans doute pas conscience qu’il prépare le terrain pour la robotisation puis pour l’intelligence artificielle.

Analyser l’organisation du travail dans de nombreuses entreprises fait prendre conscience de cette recherche constante de segmentation du travail. Comme si la tâche de chacun, très circonscrite, permettait plus facilement de remplacer une personne par une autre. Personne ne maîtrise l’ensemble d’un processus. Chacun reçoit le résultat du travail du précédent, et fournit son résultat au suivant. Les employés sont remplaçables parce que leur tâche est très spécialisée.

Dans ce contexte, la définition d’un agent est simple : il s’agit d’une personne ou d’une entité qui “agit”. Agir, c’est en latin « pousser devant soi » par opposition au patient qui est celui sur qui porte l’action.

Un employé est donc un agent. Il reçoit de l’information, ou de la matière, et agit. Il transmet le résultat de son action à l’agent suivant.

Dans l’industrie, un robot est également un agent : il reçoit une pièce, la transporte, l’usine, la modifie, et passe le résultat au robot suivant. Jamais un même robot ne va se charger de la totalité d’un processus de fabrication.

Développer un robot qui saurait exécuter parfaitement toutes les opérations est trop complexe et trop cher. La robotique c’est du taylorisme.

Les Agents IA : des “robots” intellectuels

Si en philosophie, un agent est “celui qui agit”, en informatique, un agent IA est un petit programme autonome qui exécute une tâche bien définie. Contrairement à une IA plus “généraliste” comme ChatGPT (qui peut produire différents types de textes), un agent IA est spécialisé et peut communiquer avec d’autres agents pour former une chaîne d’actions.

On peut donc voir un agent IA comme un “mini-robot intellectuel” capable de :

- Recevoir une information.

- Exécuter une tâche, auparavant assurée par un Humain, en fonction de règles ou d’objectifs.

- Transmettre le résultat à l’étape suivante.

Le travail d’un employé ne peut être remplacé par un seul agent, mais par une succession d’agents spécialisés. Ils communiquent entre eux et peuvent prendre des décisions simples (continuer, arrêter un processus, signaler une erreur…) basées sur des règles établies par l’humain qui les a programmés.

L’exemple du commercial appuyé par des agents IA

On peut imaginer qu’un commercial ne soit pas remplacé par une seule IA mais par une chaîne d’agents spécialisés, chacun réalisant une étape précise du cycle de vente.

Prenons l’exemple d’un commercial en charge de vendre des logiciels à des entreprises. Segmentons et relions les différents éléments qui composent son travail.

- Agent “Prospection” : scrute LinkedIn, des bases de données ou des salons virtuels pour identifier des prospects correspondant à un profil cible.

- Agent “Prise de contact” : rédige des emails personnalisés ou envoie des messages via LinkedIn, adaptés au secteur et aux besoins détectés.

- Agent “Qualification” : échange avec le prospect via un chatbot vocal ou écrit, pose des questions, et évalue le niveau d’intérêt.

- Agent “Démo/Argumentaire” : organise une démo interactive, répond aux objections en temps réel grâce à une base de connaissances.

- Agent “Closing & Suivi” : prépare le devis, gère la signature électronique, et planifie le suivi post-vente.

Vers un “internet des agents” ?

Alors, notre commercial est-il remplaçable ? Sans doute pas encore car dans certaines phases, une compréhension humaine du besoin est nécessaire. Le non-verbal sera dans un premier temps, mal compris par les agents dits “intelligents”. Le commercial gagnera ainsi du temps pour se concentrer sur les moments où l’intuition humaine, la négociation fine et la relation personnelle font la différence.

Par ailleurs le client n’acceptera pas forcément de traiter de manière déshumanisée avec un vendeur IA. À moins que l’acheteur du client ne soit aussi lui-même une IA…

On peut imaginer un futur où les agents IA d’une entreprise discuteront directement avec ceux d’un client… et négocieront entre eux ! Cette idée amène à imaginer un « internet des agents » mais c’est une autre histoire sur laquelle nous reviendrons…

Les enjeux humains et éthiques à anticiper

Les dirigeants et leur DRH vont pouvoir enrichir leurs feuilles de route dans les prochaines années… Nous les résumons ici par 3 challenges :

- Réinventer le rôle de l’humain : moins d’exécution, plus de supervision et de créativité.

- Maintenir la motivation : si les tâches humaines restantes sont trop fragmentées, le travail pourrait perdre son sens.

- Adapter la gouvernance et les responsabilités : qui est responsable si un agent commet une erreur lourde ? Celui qui l’utilise, celui qui l’a développé, celui qui le supervise, ou… personne ?

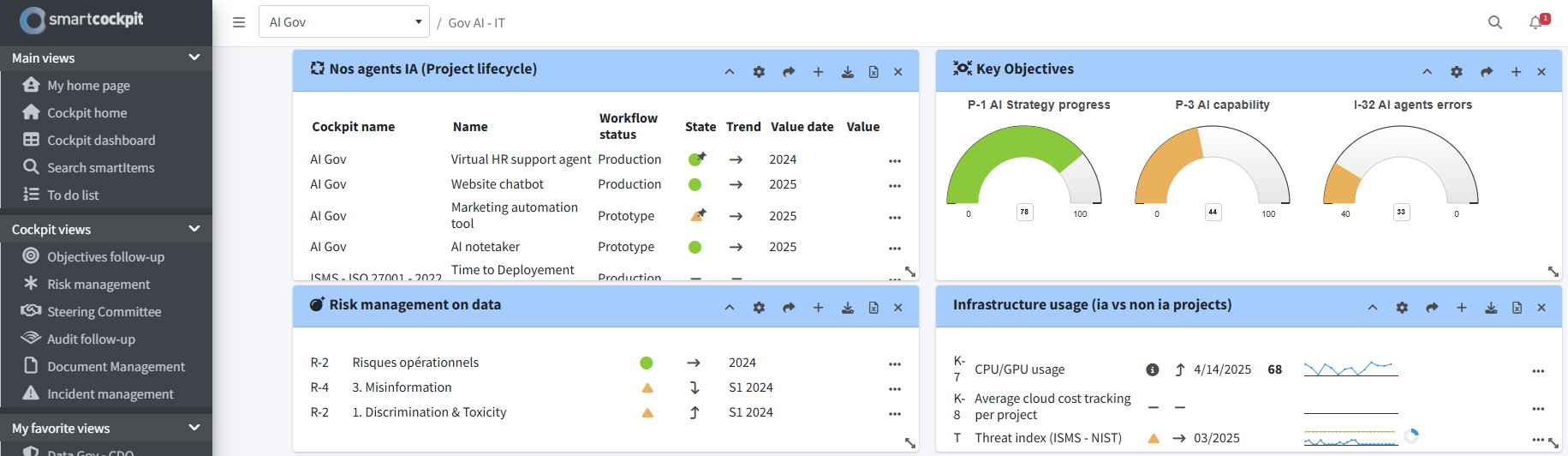

Piloter son “armée d’agents”

Bien sûr, une entreprise, créée sur le principe de l’affectio societatis, ne fonctionnera pas sans humain (pour le moment).

Ce sont donc des humains qui piloteront les agents IA, tel une armée de petits soldats, respectant parfaitement les ordres, mais à qui on ne demande pas de prise d’initiative.

Ils seront des dizaines, puis des centaines, voire des milliers peut-être. Chacun exécutant une tâche, tout en n’étant qu’un élément d’un ensemble plus complet. Et cet constellation d’agents devra être piloté :

- Un tableau de bord pour suivre leurs actions, leurs erreurs et leurs résultats.

- Des indicateurs clairs pour mesurer leur efficacité.

- Des garde-fous pour éviter les dérives (ex. : prise de décision automatique non validée par un humain).

Attention, tout ne va pas être aussi simple. Les phases de mise en œuvre révéleront des déceptions : le cabinet Gartner estime que 40 % des projets d’agents intelligents pourraient être abandonnés d’ici 2027 (1). D’où l’importance d’encadrer et de gouverner ces innovations