Vous avez déjà lu des dizaines (ou plus) de cas d’utilisation de l’IA dans des entreprises de toutes tailles et de tout secteur d’activité. Apprentissage machine, IA générative, Deep Learning, c’est la course à celui qui développera le plus de PoCs (les fameuses Preuves de Concept qui visent à tester une application avant de la développer intégralement) !

Bien souvent – trop souvent – ces études de cas font la part belle aux technologies, aux modèles, aux LLMs et autres RAGs… Nous avons choisi un angle légèrement différent, celui de leur cadre de gouvernance. Voici donc ci-dessous six exemples d’utilisation de l’IA en entreprise, commentés et complétés sous le regard de leur gouvernance. A vous de réfléchir aux impacts dans votre organisation. Et ça, réfléchir, et faire une analyse d’impact humain, rassurez-vous, l’IA n’est pas encore capable de le faire. A vous de jouer !

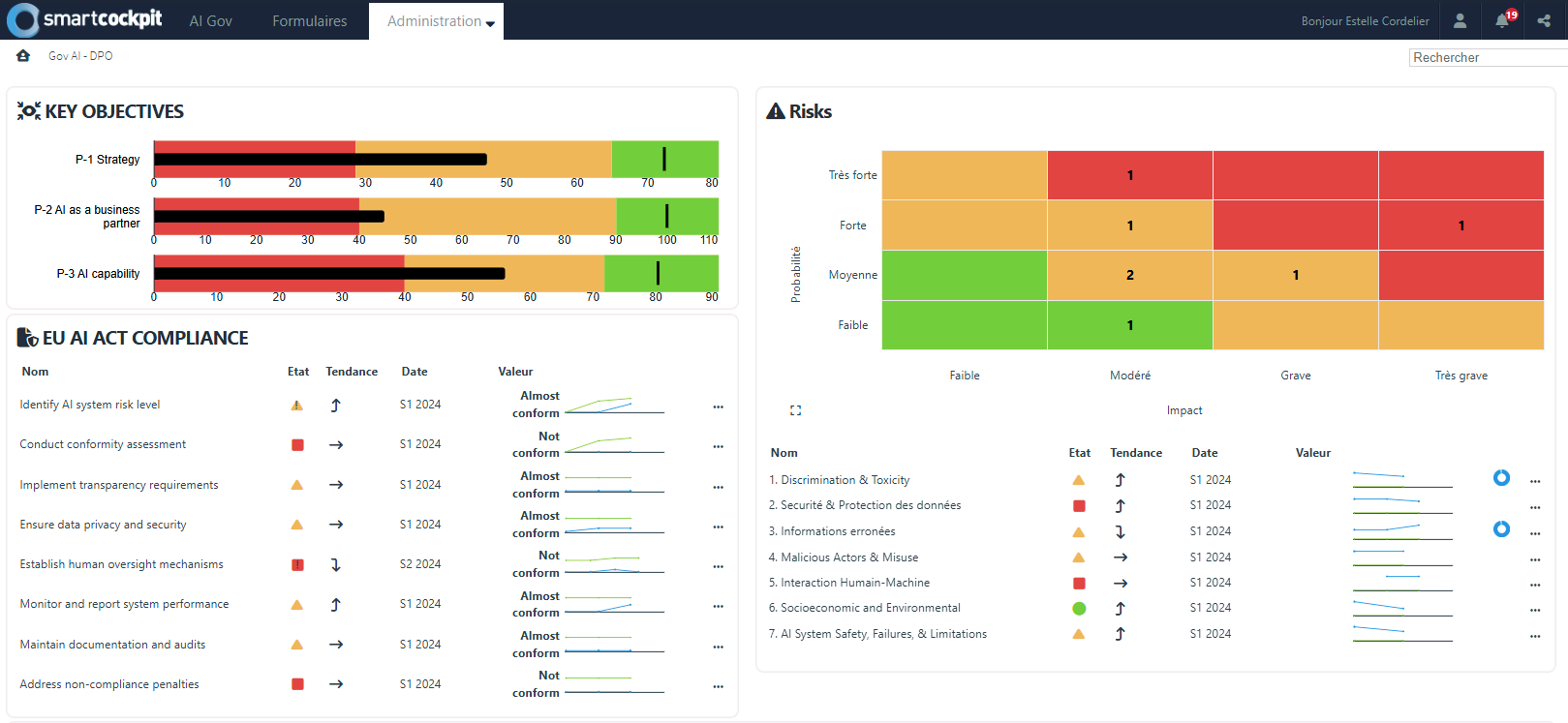

Et s’il n’y a qu’une conclusion à retenir de ce chapitre illustratif : tout projet d’IA, dès sa conception doit avoir son cockpit de suivi. Et ce cockpit personnalisé doit être intégré dans une vue plus globale à l’échelle de l’entreprise.

Cette newsletter est co-écrite par Philippe NIEUWBOURG ( Decideo ), Julien Soulard ( smartcockpit ) et Estelle Riboni-Cordelier ( OXIBI SA )

Air France déploie PamelIA

Dans les prochains mois, les agents au sol d’Air France dans les aéroports, disposeront d’une application les aidant à renseigner les clients. Bagages, retards, services, connexions… les interrogations des voyageurs lorsqu’ils arrivent dans un aéroport sont nombreuses. Or le transport aérien, par sa complexité, s’appuie sur des applications et données souvent en silos. L’interconnexion entre ces applications n’est pas simple à réaliser, et les agents au sol doivent jongler entre les écrans.

D’où l’idée de PamelIA, croisement d’un chatbot et d’une IA générative, qui équipera peu à peu les tablettes déjà utilisées par les agents au sol d’Air France. Au travers d’une interface unique, l’agent posera la question du client, et une réponse sera directement générée. L’agent au sol sera en mesure d’évaluer la qualité de la réponse et la transmettra au client. On peut aussi imaginer une réponse rédigée dans la langue du client, même si l’agent ne la maitrise pas.

Notre analyse :

Comme toute IA générative, une attention particulière devra être portée à l’exactitude des réponses. Les risques commerciaux et financiers d’une mauvaise recommandation faite au client sont importants. Le cockpit de PamelIA devra surveiller et mesurer les hallucinations éventuelles ; un canal de remontée d’erreurs en provenance des agents utilisateurs pourrait raccourcir le délai d’alerte.

Autre impact, à plus long terme, la place des personnels au sol… Les bornes d’auto-enregistrement ont déjà largement remplacé les comptoirs ; l’enregistrement des bagages se fait également au travers d’une machine… bien moins tolérante sur les kilos supplémentaires qu’un agent Air France ; si PamelIA fonctionne, pourquoi ne pas envisager ensuite de la mettre à disposition sur des bornes de self-service, et ainsi supprimer certains postes d’assistance humaine. Pas d’IA sans des impacts humains et sociaux, que la gouvernance va chercher à anticiper, pour les traiter correctement.

Sources :

Spotify

C’est la “perfect storm” que Spotify est en train de développer autour de l’IA dans le monde de la musique. Une tempête parfaite pour Spotify, mais pas forcément pour les musiciens… Spotify, ce sont tout d’abord 100 millions de morceaux de musique, mis en ligne par des musiciens amateurs ou confirmés, sur l’une des principales plates-formes mondiale. Certains gagnent quelques centimes de droit d’auteur, d’autres beaucoup plus comme Taylor Swift dont les titres avaient été écoutés 26 milliards de fois fin 2023 ! Ce sont également des centaines de millions d’utilisateurs mensuels (Spotify vise un milliard d’utilisateurs en 2030) dont les habitudes, les gouts musicaux, sont collectés, conservés et scrutés dans un des systèmes big data les plus complet au monde. De l’apprentissage machine permet donc de prévoir quel titre chaque utilisateur souhaiterait écouter, en fonction de sa localisation, de l’heure de la journée, et bien sûr de ses préférences musicales.

Avec ces 100 millions de titres dans ses bases de données, Spotify a compris disposer d’une base incroyable pour alimenter une IA générative de musique. Si vous construisez un prompt sur la base du profil d’un utilisateur précis, un LMM (Large Music Model) pourra produire à la volée une playlist de musiques artificielles composée à partir de vos goûts musicaux. Or selon des dirigeants de Spotify, “l’utilisateur moyen ne ferait pas la différence entre ces créations artificielles et celles d’artistes réels”… le compte de résultats de Spotify, si ! Car il n’y a plus de droits à reverser sur les créations artificielles… les musiciens apprécieront… ou pas. En intercalant des titres générés entre les titres d’artistes réels et connus, Spotify pourrait baisser drastiquement son coût horaire.

Notre analyse :

Bien entendu, Spotify devra vérifier la qualité des titres générés par son IA ; mais également l’adéquation avec les attentes des utilisateurs. Nous suggérerions à Spotify d’inclure dans son cockpit des indicateurs sur la durée d’écoute, sur le “churn”, c’est à dire la tendance à passer à autre chose, une valorisation à base de likes. Tout cela devra être suivi séparément pour les titres d’artistes réels et d’artistes artificiels. Cela permettra de vérifier que les auditeurs ne font en effet pas la différence.

Autre risque plus commercial, un éventuel boycott de la part des musiciens qui retireraient leurs titres de la plateforme et n’en soumettraient pas de nouveaux. L’IA se cannibaliserait alors à terme et la qualité des musiques générées baisserait, entrainant la baisse des abonnements. Donc, à surveiller dans le cockpit !

Source :

Application smartway – contre le gaspillage alimentaire

Smartway est une application intégrant un système IA contre le gaspillage alimentaire. Plusieurs grandes enseignes utilisent aujourd’hui cet outil : Auchan, Carrefour ou Leclerc (liste non exhaustive). Son fonctionnement est relativement simple, Smartway liste les produits en rayon approchant ou ayant atteint la DDM (Date de Durabilité Minimale) ou DLC (Date Limite de Consommation). Ces produits sont ensuite proposés avec une réduction aux clients, afin d’optimiser la revalorisation du produit. C’est à cette étape que l’IA entre en compte, elle va définir la réduction à apporter sur le produit selon la saisonnalité, les habitudes de consommation dans le magasin, etc. Une cinquantaine de paramètres permettent à l’IA de générer la réduction la plus appropriée. Le système ne proposera donc pas la même réduction pour des glaces arrivées à la DDM si l’on est en hiver ou en été. Il permet également aux grandes surfaces de mieux gérer leur stock grâce à la géolocalisation dans les rayons des produits atteignant les dates courtes. Ceci apporte un gain de temps considérable dans le tri des produits et une meilleure gestion des stocks.

Un supermarché propose entre 30 000 et 60 000 références, la sélection des produits à date courte est tout simplement impossible sans un bon suivi des données de chacun (on pourrait d’ailleurs parler de métadonnées). L’IA apporte ici une réelle plus-value pour déterminer un rabais qui permettra la vente du produit et ainsi résoudre deux problématiques : réduire le gaspillage et limiter les pertes financières sur ces produits autrement jetés à la poubelle.

Notre analyse :

Le premier point que nous aborderions dans la gouvernance est la transparence des décisions de l’IA sur le taux de réductions, on pourrait donc mesurer le nombre de consultation du justificatif du taux de réduction. Nous intégrerions également dans le cockpit le suivi des biais potentiels qu’il soit voulu ou non, avec le taux de disparité (par type de produit, enseigne ou lieu géographique). Afin d’avoir une vision complète nous suivrions aussi la réactivité de l’IA aux nouvelles réglementations sur le marché de l’alimentaire. Et enfin, il nous semblerait important de suivre les interventions humaines, pour s’assurer que l’IA n’est pas seule partie prenante dans les décisions critiques (taux de décisions ajustées, taux de validation humaine des suggestions, etc).

Sources:

Carrefour estime la valeur d’un véhicule avec ProovStation

Carrefour a installé des bornes ProovStation permettant d’estimer la valeur de votre véhicule et ce gratuitement. C’en est fini des heures d’attente chez le garagiste ou des négociations chez un concessionnaire sur des détails techniques que vous ne maitrisez pas. En moins de cinq secondes un diagnostic de l’état de votre véhicule est effectué par ProovStation et vous recevez dans l’heure qui suit une offre de rachat auprès de l’un des partenaires. L’estimation est faite en toute impartialité nous dit-on : vous donnerez quelques détails techniques sur votre véhicule à la borne, qui va ensuite le scanner et le photographier sous différents angles afin d’en déterminer la valeur. Dans le compte-rendu, le système vous informe de l’état de vos pneus ainsi que celui de votre véhicule. Vous aurez une semaine pour accepter l’offre que vous avez reçue. Si vous l’acceptez, vous recevrez le montant sur votre compte bancaire et ProovStation se chargera de venir récupérer votre véhicule. Simple et efficace pour améliorer le quotidien. Le gain de temps est considérable par rapport au passage chez un concessionnaire, c’est incontestable !

Notre analyse :

Il va de soi que la qualité des images prise par la machine doit être irréprochable pour ne pas générer une fausse analyse. Voici également ce que nous aurions suivi dans le cadre de la gouvernance de l’IA pour anticiperles risques. Nous proposerions un indicateur pour suivre les biais lors de l’estimation. On pourrait ainsi suivre au sein du cockpit l’alignement entre les offres de Proovstation et d‘autres offres existantes sur le marché, ou encore les déviations par type de véhicule (marque, année de construction, couleur, etc). Il serait également intéressant de suivre le pourcentage de clients acceptant l’offre de rachat, ou les contestations, pour avoir une vision de la satisfaction des utilisateurs. Enfin, il serait important d’avoir un kpi de suivi de l’adaptabilité du modèle, que ce soit par la fréquence de sa mise à jour, ou encore du suivi des tendances du marché. A suivre attentivement pour ne pas être déconnecté de la réalité du marché.

Source :

JPMorgan Chase utilise l’IA pour lutter contre les fraudes

La croissance du numérique dans le monde bancaire et la croissance des transactions en ligne font exploser les risques de fraude. Les fraudeurs usent de techniques de plus en plus sophistiquées, obligeant les banques à repenser leurs systèmes de détection. Le coût des fraudes se compte en milliers de milliard de dollars chaque année. Fin 2023, JP Morgan a mis sur pied un modèle d’IA qui analyse les données de chaque transaction, permettant de détecter les anomalies, elle s’appuie notamment sur les déviances comportementales face aux normes historiques. Le modèle réduit les faux positifs (vraies transactions considérées par le système comme fraude), elle permet ainsi de prévenir et d’éviter 50% des fraudes. Ce changement est considéré comme une révolution industrielle, la réduction des tentatives de fraudes améliore l’expérience client, réduit les coûts opérationnels et minimise les pertes financières, dépassant de loin l’efficacité des méthodes traditionnelles.

Notre analyse :

Dans ce domaine très sensible nous suggérerions des indicateurs liés à la loi RGPD (ou LPD) afin de prévenir les risques de violation des règlementations. Nous préconiserions également un indicateur sur la fréquence de mise à jour du modèle, les techniques de fraudes étant de plus en plus sophistiquées, le modèle IA doit être mis à jour régulièrement afin d’éviter une obsolescence. Nous aurions également sur notre cockpit de gouvernance des indicateurs pour suivre les contestations des décisions de l’IA et un indicateur pour suivre la transparence du modèle qui serait donné par le temps moyen pour expliquer une décision IA à un client ou à un régulateur. La quantité de transactions analysées par le modèle est gigantesque, avoir une vision claire des risques et leurs mitigations est primordiale. L’utilisation d’un cockpit dédié nous semble essentielle dans ce contexte.

Source :

SNCF : L’IA générative Claude d’Anthropic assiste les téléconseillers de la SNCF

Depuis maintenant six mois, une IA générative est en place. Elle analyse la question posée par le client par email, puis propose une réponse au conseiller. Celui-ci a la possibilité d’éditer ce texte, de le valider ou de refuser. L’objectif est d’offrir un outil d’aide au conseiller et, lorsqu’il personnalise la réponse ou qu’il la refuse, cela vient alimenter le LLM (Large Language Model) pour qu’il améliore encore ses réponses.

L’objectif est de réduire le délai de réponse de l’IA générative. « 14 secondes, c’est déjà mieux que la moyenne, mais notre objectif est de réduire cette attente, car nous savons que chaque seconde est importante dans la relation client. » Avec six mois de recul, le temps de traitement moyen des demandes par les conseillers a été réduit de 30 secondes et la satisfaction client (C-SAT) a été améliorée de 150 %. L’enquête post-contact envoyée systématiquement a permis de vérifier que toutes les réponses générées par l’IA et validées par les conseillers ont un taux de satisfaction globalement meilleur.

Notre analyse :

Le gain d’efficacité semble indiscutable, tant pour les conseillers que pour les clients.

Néanmoins, deux points d’attention nous semblent à intéressants à soulever :

- Attention à l’autonomie laissée au conseiller pour juger de la pertinence des réponses proposées : sur le plan relationnel et commercial, contrairement aux humains, les IA ne perçoivent pas les émotions et peuvent suggérer des réponses inadaptées manquant d’empathie dans des situations sensibles… et sur le plan de la conformité, l’utilisation de l’IA implique d’avoir au préalable bien posé avec les conseillers les risques en matière de sécurité et de respect de la vie privée pour éviter toute erreur d’usage.

- Enfin, sur le plan des compétences, certains employés peuvent potentiellement devenir trop dépendants de l’IA, limitant ainsi progressivement leur capacité à traiter des cas complexes de manière autonome. Il serait d’ailleurs intéressant de connaitre l’évolution depuis sa mise en place du taux de personnalisation par le conseiller. Se repose-t-il de plus en plus sur l’IA ? Lui fait-il confiance ? Pourrait-il alors être remplacé demain (par exemple lorsqu’il est en grève) ?

Sources :

La Revue du Digital => L’IA générative Claude d’Anthropic assiste les téléconseillers de la SNCF – La Revue du Digital